Hinton神经网络公开课6 Optimization: How to make the learning go faster

这节课围绕着如何加快训练速度这个现实问题,从理论上分析了学习过程中的问题,介绍了许多实践中有效的锦囊妙计。 复习 先复习一下优化理论中的几个概念。 weight space中的error surface 以误差为y轴,每个权值为x轴可以得到...

这节课围绕着如何加快训练速度这个现实问题,从理论上分析了学习过程中的问题,介绍了许多实践中有效的锦囊妙计。 复习 先复习一下优化理论中的几个概念。 weight space中的error surface 以误差为y轴,每个权值为x轴可以得到...

斯坦福UFLDL中CNN剩下两章的笔记,辅以两次编程练习,至此完成了CNN的学习。 梯度下降概述 诸如L-BFGS之类的批优化方法每次更新都使用整个训练集,能够收敛到局部最优。因为要设置的超参数很少,所以很好用,matlab里也有许多类似m...

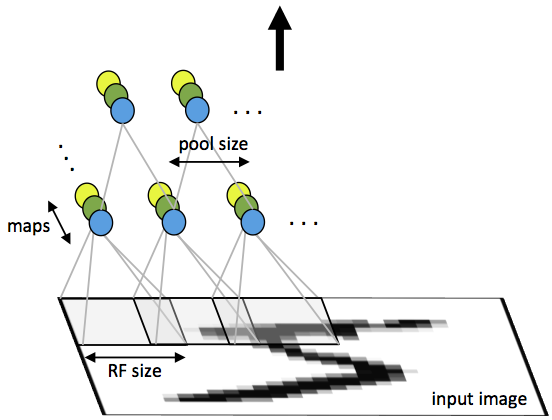

这是关于斯坦福大学的UFLDL(Unsupervised Feature Learning and Deep Learning)中CNN一章的笔记,用来补足Hinton神经网络公开课略过的部分。 概览 前几次练习解决了处理低分辨率图片的问题...

一些使用了matplotlib的脚本在启动的时候就会在dock上显示一个小火箭: 如果脚本在执行很耗时的操作,比如训练,则UI长期得不到响应,这个小火箭就会一直瞎蹦跶,怪讨厌的。解决方法有两个: 配置文件解决 vi /path/t...

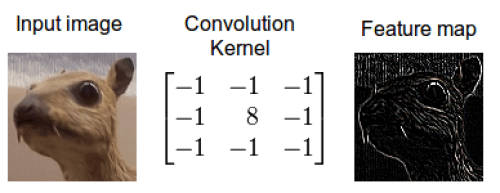

译自Tim Dettmers的Understanding Convolution in Deep Learning。有太多的公开课、教程在反复传颂卷积神经网络的好,却都没有讲什么是“卷积”,似乎默认所有读者都有相关基础。这篇外文既友好又深入...

这节课蜻蜓点水地讲了图像识别和卷积神经网络,老爷子讲得实在很简略。所以这节课不能当作CNN的入门资料,如果感觉任何地方不清楚,不要沮丧,因为根本没讲。 图像识别的难处 为什么最新的技术只能做到十几二十几的error rate呢,因为图像识别...

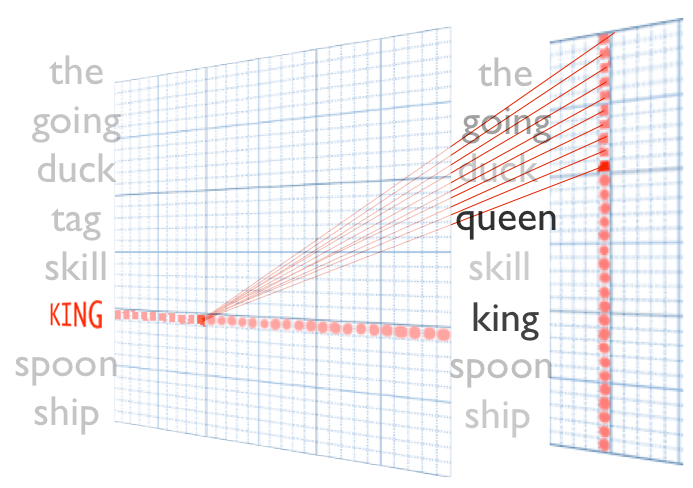

这次练习的任务是设计一个神经网络语言模型,给定前三个词语,预测第四个词语。通过训练该语言模型学习词的稠密表示,大部分代码已经写好,少量难点以选择题的方式给出。 数据集 词表大小250,训练集由30万个4-gram构成,开发集和测试集大小为5...

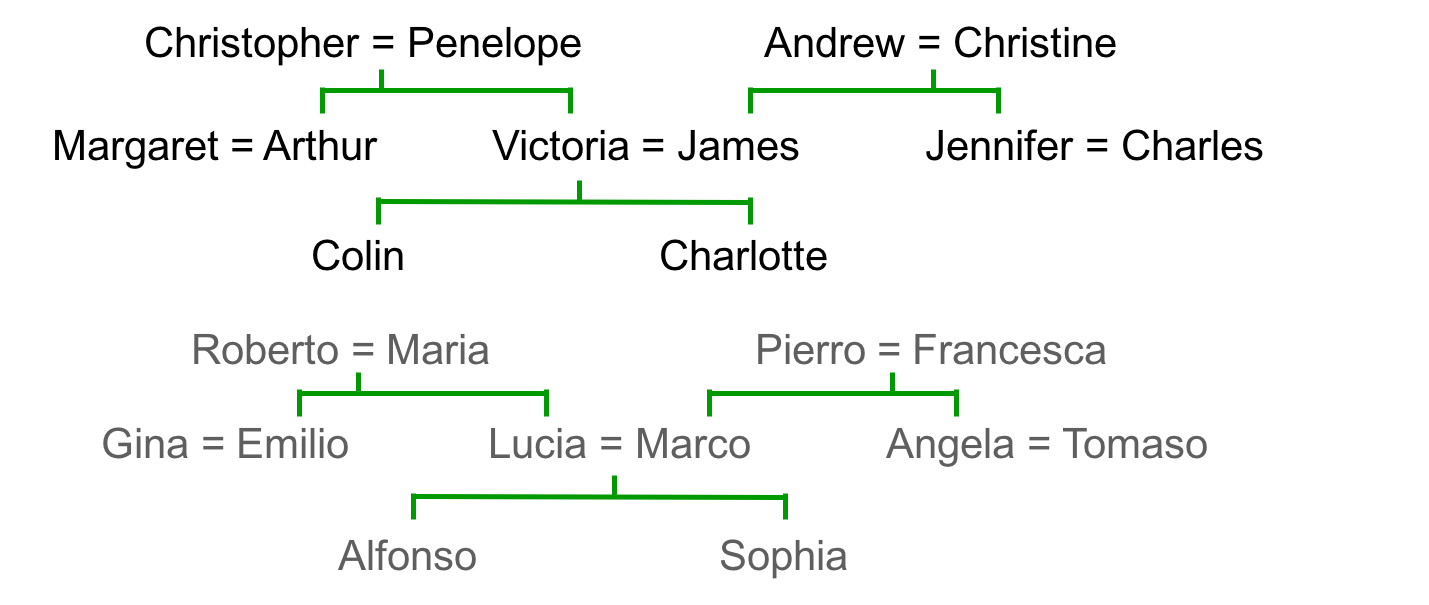

词的向量表示 关系信息的特征表示 引子很新奇,是一张英国人的家谱和一张结构相似的意大利人的家谱: 这是一种关系信息,比如甲的父亲是乙,=表示夫妻。神经网络可以通过反向传播学习这些关系对,将关系信息转为特征向量。最终的效果是,提问“乙的儿子是...

这门课的编程练习很简单,大部分代码都给出了,只需要修改或添加一小部分。官方语言为matlab,但我更喜欢Python(讨厌jupyter)。但matlab保存动画更方便,所以决定双语字幕,左右开弓。 算法主框架 这次的主题是感知机算法及可视...

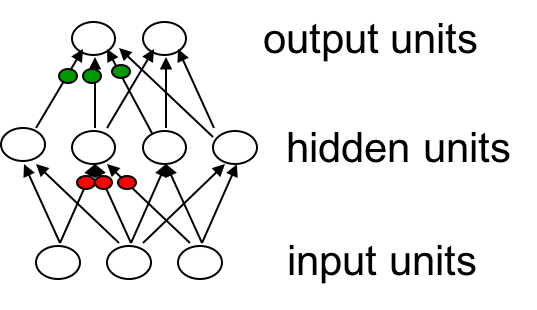

虽然反向传播很简单,但老爷子讲的更本质。另外线性回归→逻辑斯谛回归→反向传播神经网络是很多课程的必经之路。 为什么感知机算法不能用于训练隐藏层 其实前面一次课简单地提了下,说是线性隐藏层构成的模型依然是线性的。这节课展开了讲,感...