CS224n笔记13 卷积神经网络

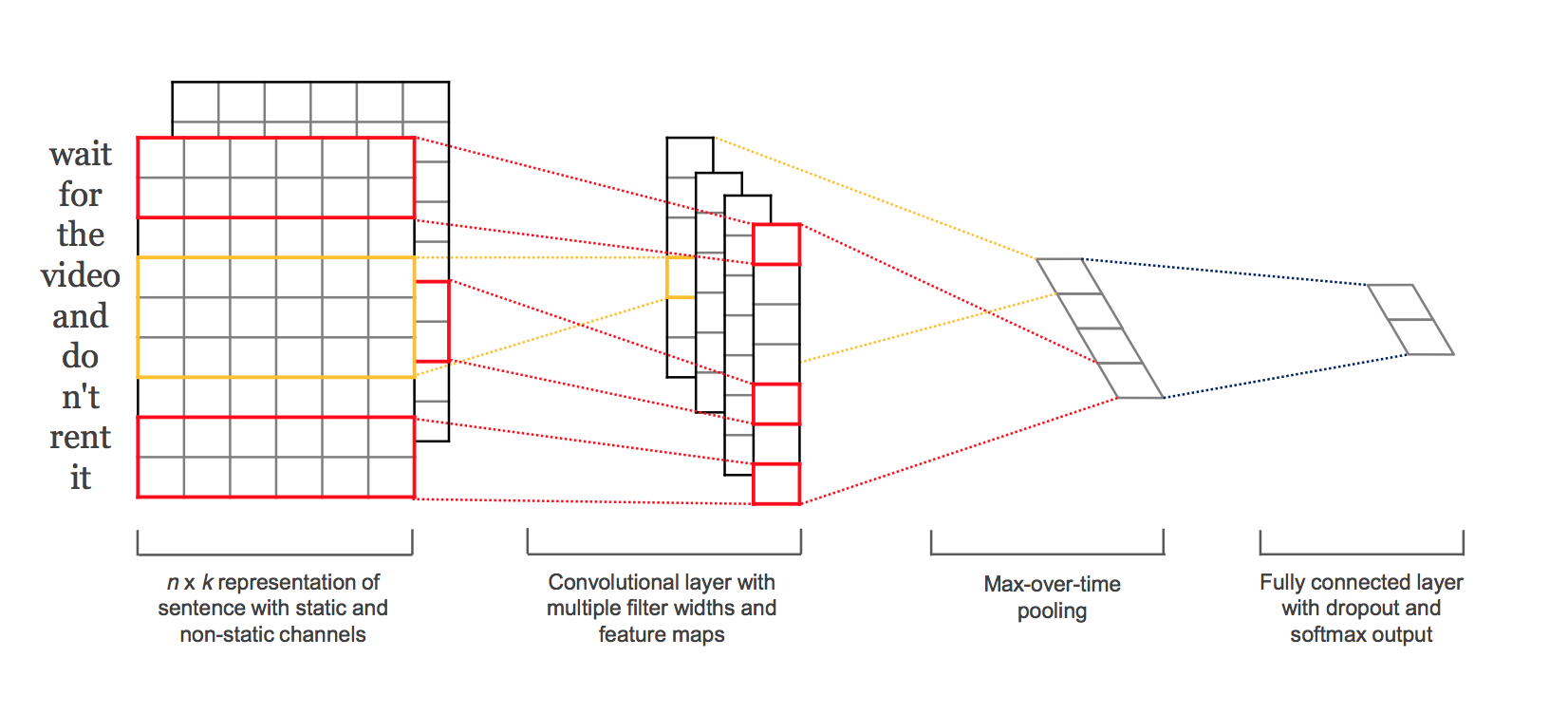

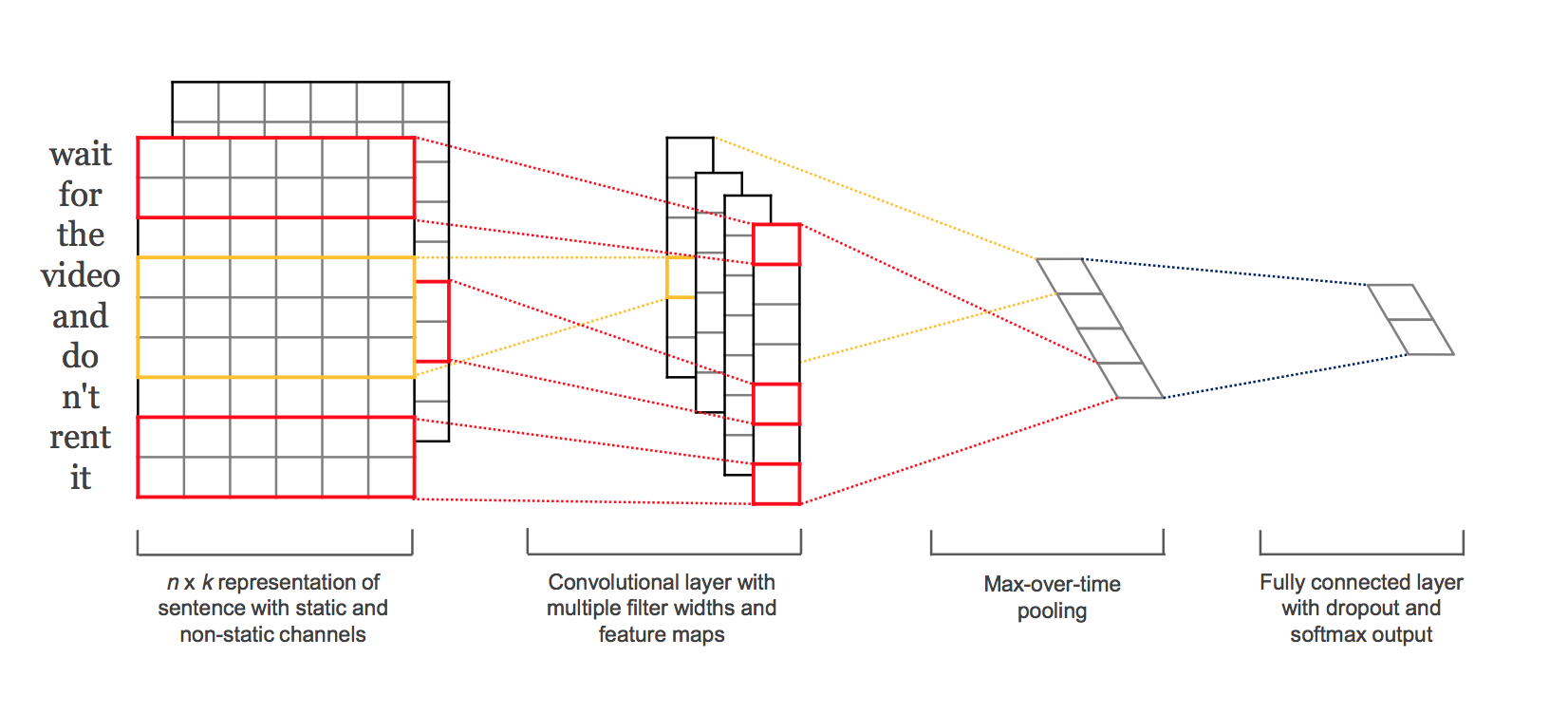

补充了NLP中相对冷门的CNN,谈了谈调参与发论文的潜规则。 从RNN到CNN RNN无法利用未来的特征预测当前单词,就算是bi-RNN,也不过是双向重蹈覆辙而已。 经常把过多注意力放到最后一个单词上。 比如,如果只想得到my birth的...

补充了NLP中相对冷门的CNN,谈了谈调参与发论文的潜规则。 从RNN到CNN RNN无法利用未来的特征预测当前单词,就算是bi-RNN,也不过是双向重蹈覆辙而已。 经常把过多注意力放到最后一个单词上。 比如,如果只想得到my birth的...

动机 大多数神经网络语言模型其实并没有注意到结构类似的词语意义也类似这种语言现象,这使它们无法赋予低频词合适的表示。所以这个新模型的目标是: 编码词素相关性:eventful, eventfully, uneventful 解决低频词问题 ...

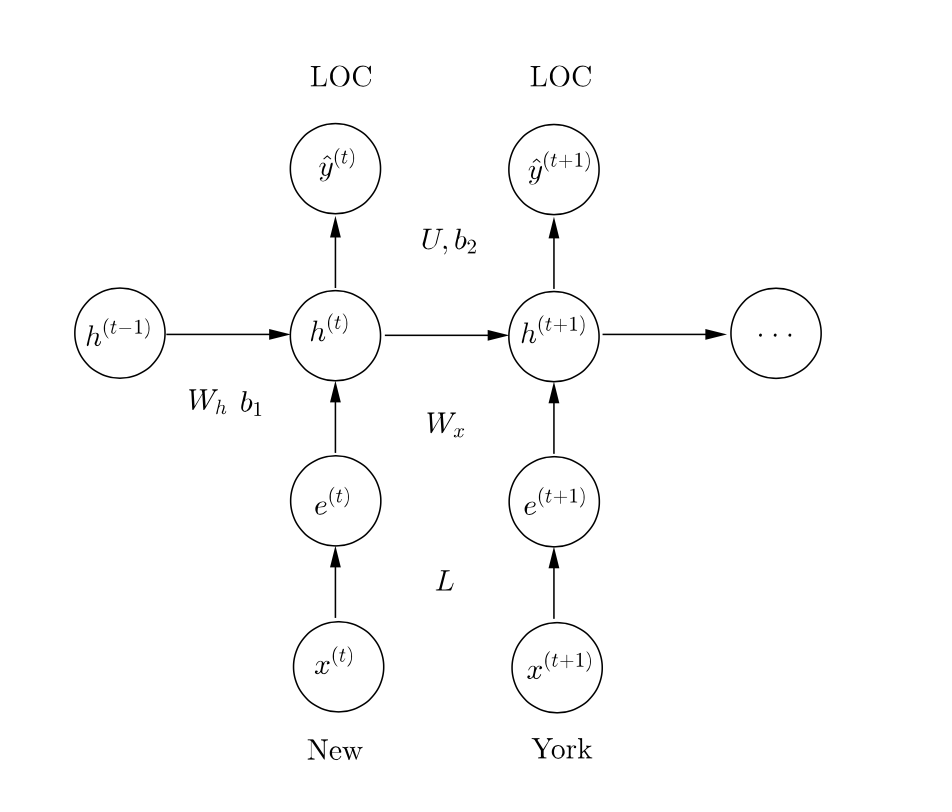

命名实体识别任务,先实现基于窗口的基线模型,然后进阶到RNN和GRU。中间利用对自动机的模拟和推导展示RNN的缺点,演示梯度剪裁的作用。这是Latex解答,代码已提交,最后还有一个彩蛋。 命名实体识别初步 定位命名实体并将其分类到: 人名P...

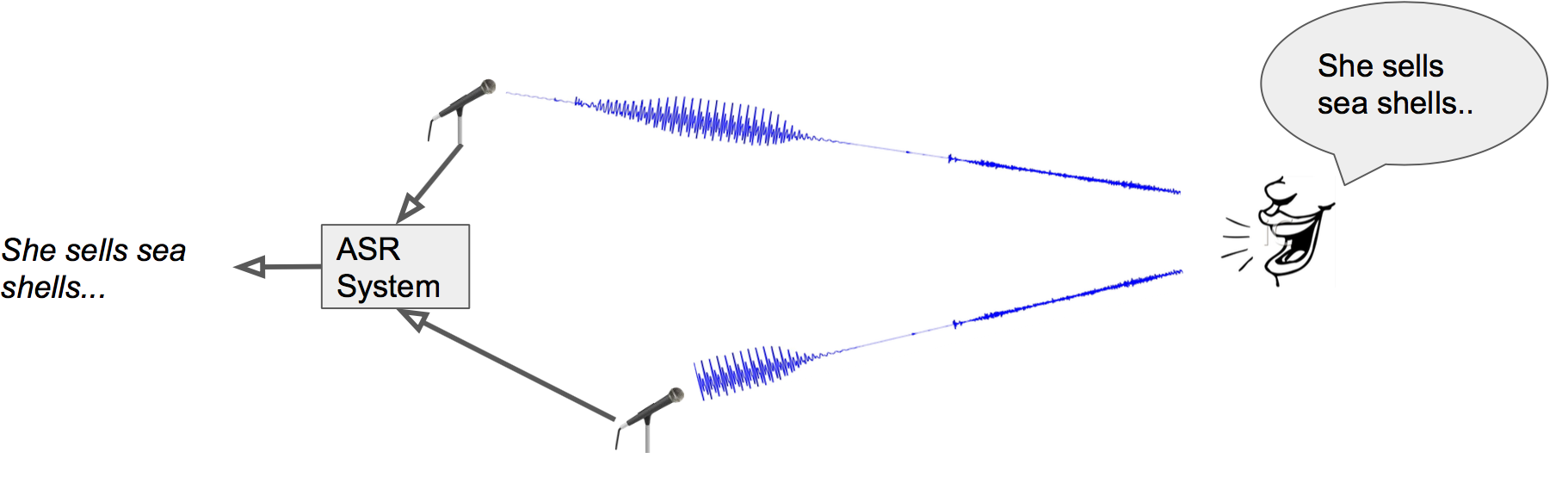

这次斯坦福请到了深度学习教父Hinton的弟子Navdeep来讲语音识别,他正在英伟达工作,怪不得N卡在深度学习中的地位如此之高。而他本人也在用Dell的搭载了N卡的XPS跑Ubuntu,一改以往“讲台必定信仰灯”的局面。 Automati...