CS224n笔记12 语音识别的end-to-end模型

这次斯坦福请到了深度学习教父Hinton的弟子Navdeep来讲语音识别,他正在英伟达工作,怪不得N卡在深度学习中的地位如此之高。而他本人也在用Dell的搭载了N卡的XPS跑Ubuntu,一改以往“讲台必定信仰灯”的局面。 Automati...

这次斯坦福请到了深度学习教父Hinton的弟子Navdeep来讲语音识别,他正在英伟达工作,怪不得N卡在深度学习中的地位如此之高。而他本人也在用Dell的搭载了N卡的XPS跑Ubuntu,一改以往“讲台必定信仰灯”的局面。 Automati...

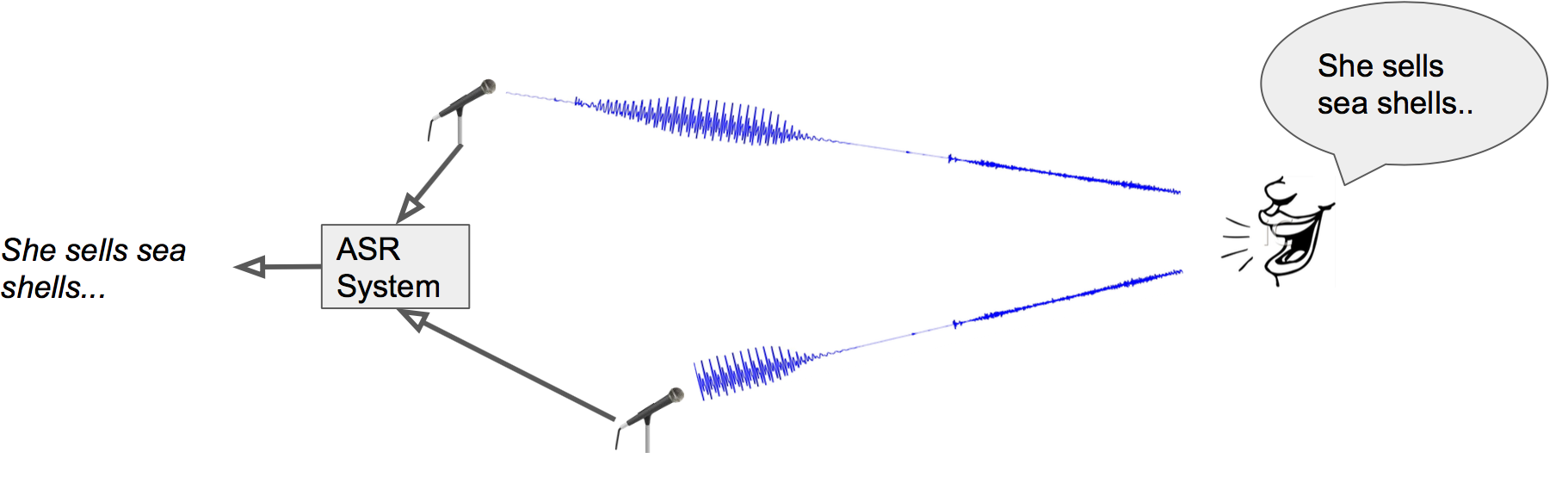

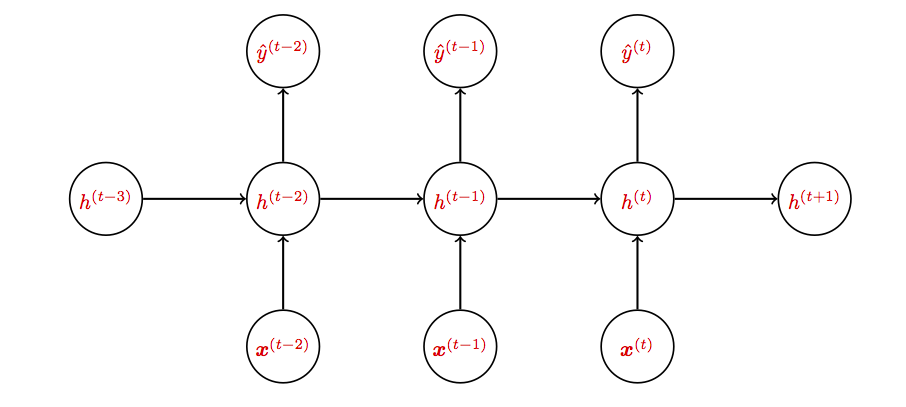

从动机层面直观地充实了GRU和LSTM的理解,介绍了MT的评测方法,讨论了NMT中棘手的大词表问题和一些常见与最新的解决办法。 深入GRU 把GRU再详细讲一讲。 RNN的梯度消失就不赘述了,红线连乘多次下溢出。 而GRU额外添...

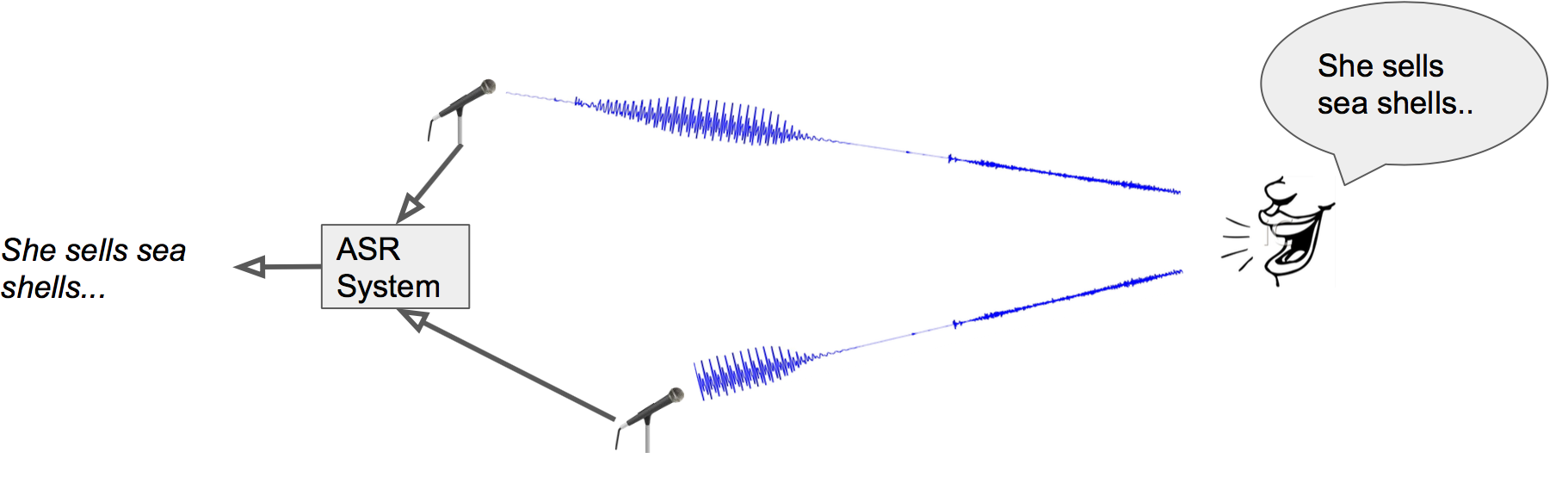

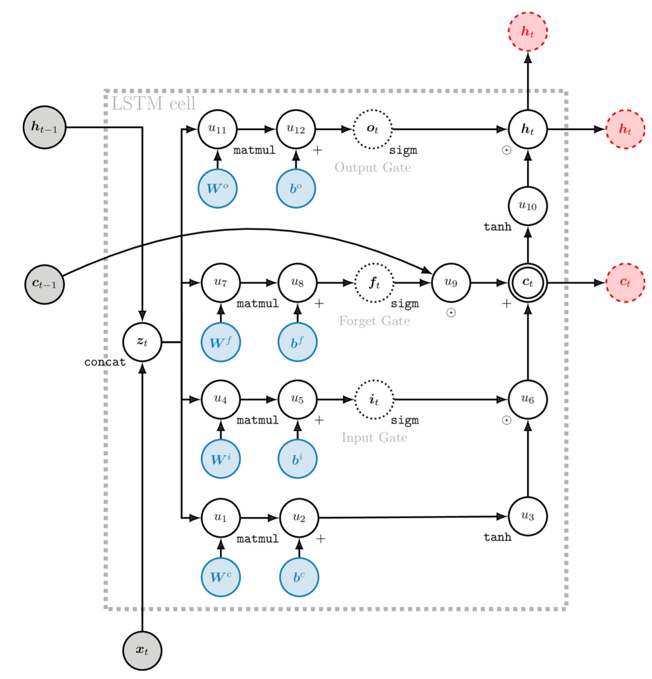

唇语翻译 将视频处理为以嘴唇为中心的图片序列,给或不给语音,预测正在讲的话。 这些数据可能来自新闻直播: 动画演示: 这里唇语和语音的识别、卡拉OK效果式的对齐,都是模型自动完成的。 架构 视觉和听觉两个模块或者混合交火或者单独使用,每次输...

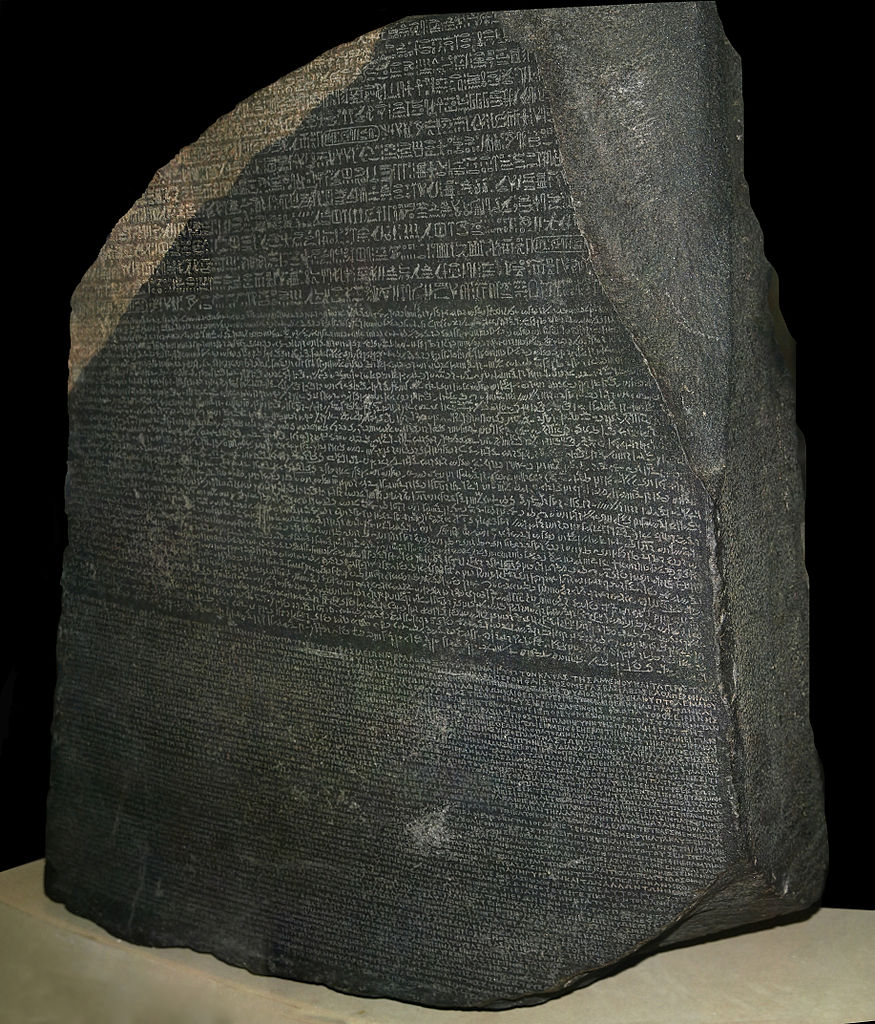

从NMT的历史谈到现代,讲解了attention机制的动机、原理及最新的拓展。通过实例展示谷歌翻译的变化,直言不讳指出其过度炒作。Manning今天还换上了新MBP,挺潮的。 机器翻译 传统衡量机器对语言理解的测试之一 同时涉及到语言分析与...

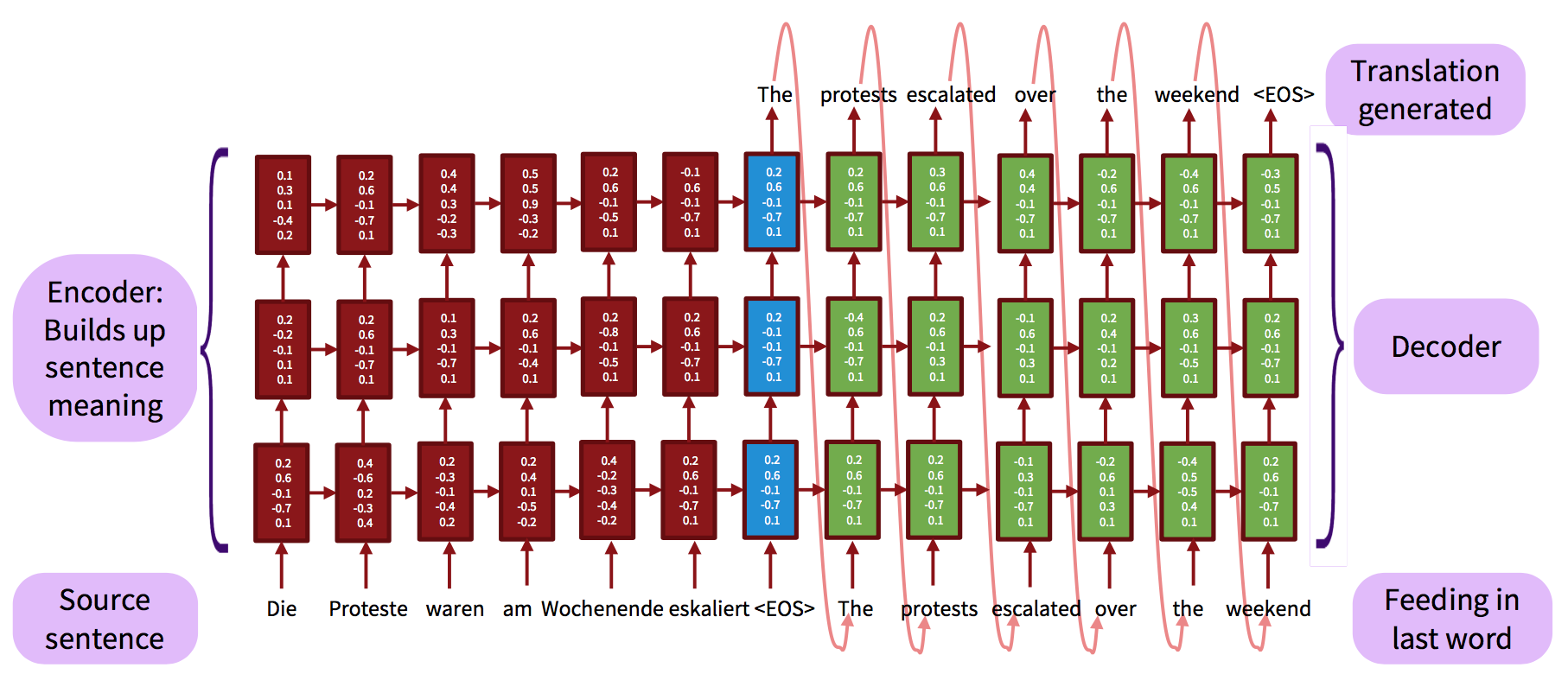

双语NMT 一般“瘦弱”的NMT系统只支持双语单向翻译,比如课上常见的这种: 如果想实现一个模型支持多语种互译怎么办呢? 土办法 之前的尝试是使用多对encoder-decoder pair、一个encoder多个decoder、多个enc...

先在TensorFlow上实现多项逻辑斯谛回归练练手,然后增加难度实现基于神经网络的转移依存句法分析,试验Xavier初始化、Dropout和Adam优化器。最后推导RNN和语言模型的困惑度、梯度、反向传播和复杂度。 Python代码开源在...

简单回顾了传统统计机器翻译中的难题,过渡到利用GRU和LSTM来救场,最后介绍了一些较新的改进工作。 机器翻译 对于情感分析这类还算简单的任务,你可以整理一个情感极性词典、编写一堆规则做出一个勉强能用的系统。但到了机器翻译这个高级应用,就无...

我们已经知道一些手段来改进语言模型,比如: 更好的输入:词→词根→字符 更好的正则化/预处理 这些手段综合起来得到了更好的语言模型 更好的输入 文本的多种颗粒度: 更细的颗粒度相当于减小了词表,让模型更容易做对选择。试验表明的确降低了err...

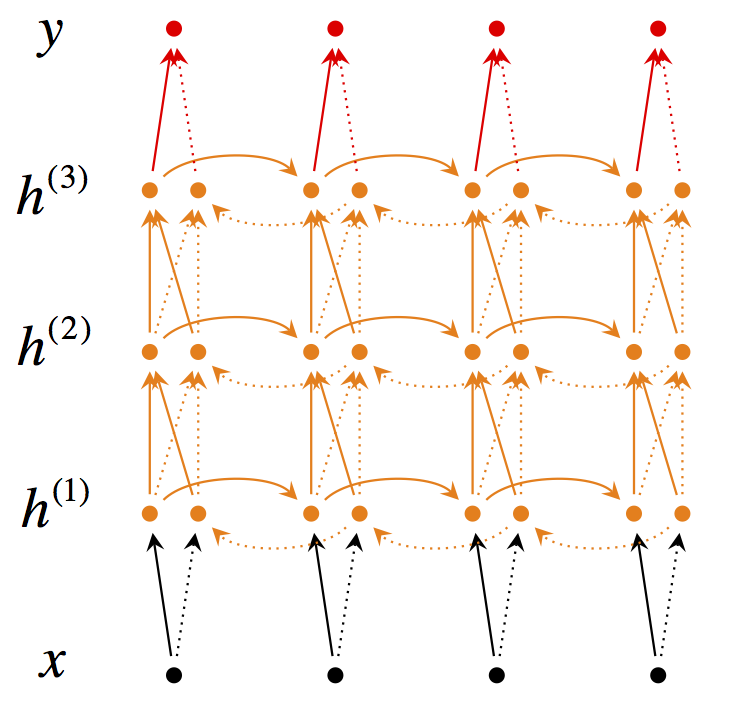

这次课推导RNN,介绍各种训练技巧和拓展变种。梯度消失的推导很详细,用Python演示很直观,也给出了用裁剪防止梯度爆炸的直观解释。笔记里还补充了用于机器翻译时的5项改进。 语言模型 语言模型就是计算一个单词序列(句子)的概率($P(w_1...

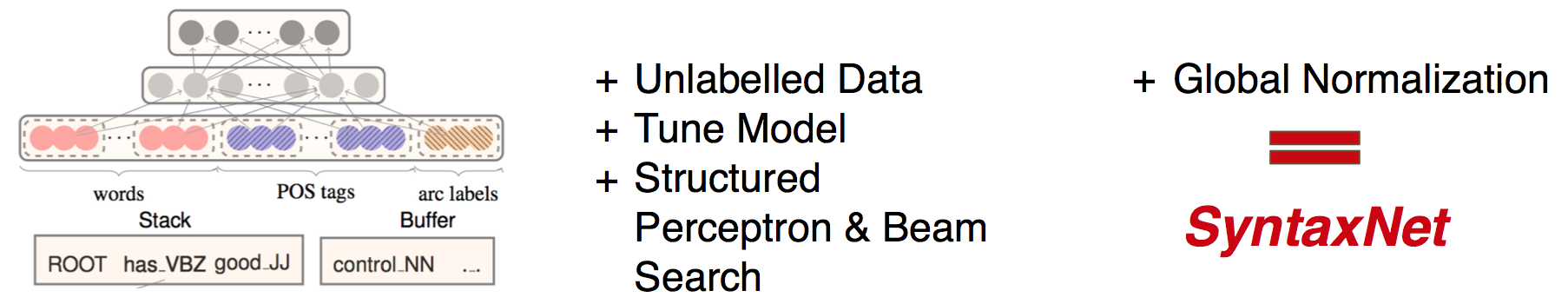

介绍了依存句法分析最近的3次突破性工作。 什么是SyntaxNet 这是谷歌在16年开源的“世界上最精准的开源句法分析器”,它基于TF来做句法分析,现在支持40种语言(不包含简体中文)。 这项工作在Chen & Manning的开山...