CS224n Assignment 1

这是LaTex答案,Python代码开源在GitHub上。先进行大量的SG、CBOW、负采样、交叉熵损失函数推导和证明,理论基础扎实后平滑过渡到实现;在斯坦福情感树库上做情感分析、调参、分析混淆矩阵与错误。 以前看不懂公式,总觉得代码是最重...

这是LaTex答案,Python代码开源在GitHub上。先进行大量的SG、CBOW、负采样、交叉熵损失函数推导和证明,理论基础扎实后平滑过渡到实现;在斯坦福情感树库上做情感分析、调参、分析混淆矩阵与错误。 以前看不懂公式,总觉得代码是最重...

主讲人是一位发音特别纯正的印度小哥,只有微量口音。这篇论文挑战了对神经网络的迷信,展示了传统模型的生命力以及调参的重要性。 词语表示方法 以前的课程中讲过两大类得到dense词语表示的方法,一般认为NN模型更好: 这里的PPMI也是一种利用...

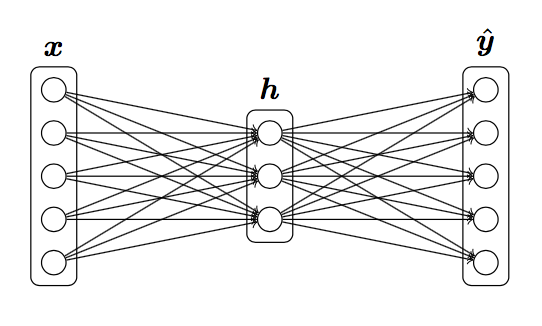

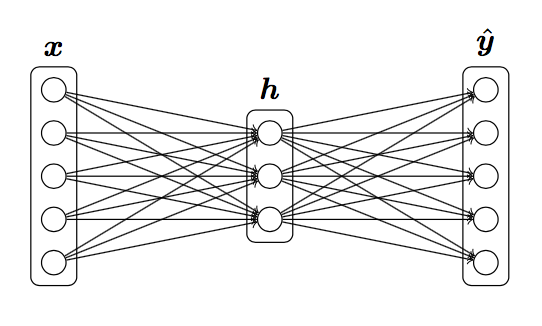

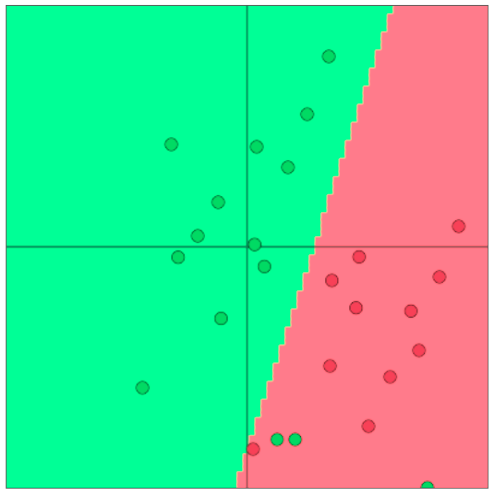

这节课介绍了根据上下文预测单词分类的问题,与常见神经网络课程套路不同,以间隔最大化为目标函数,推导了对权值矩阵和词向量的梯度;初步展示了与传统机器学习方法不一样的风格。 分类问题 给定训练集$$\{x^{(i)},y^{(i)}\}_1^N...

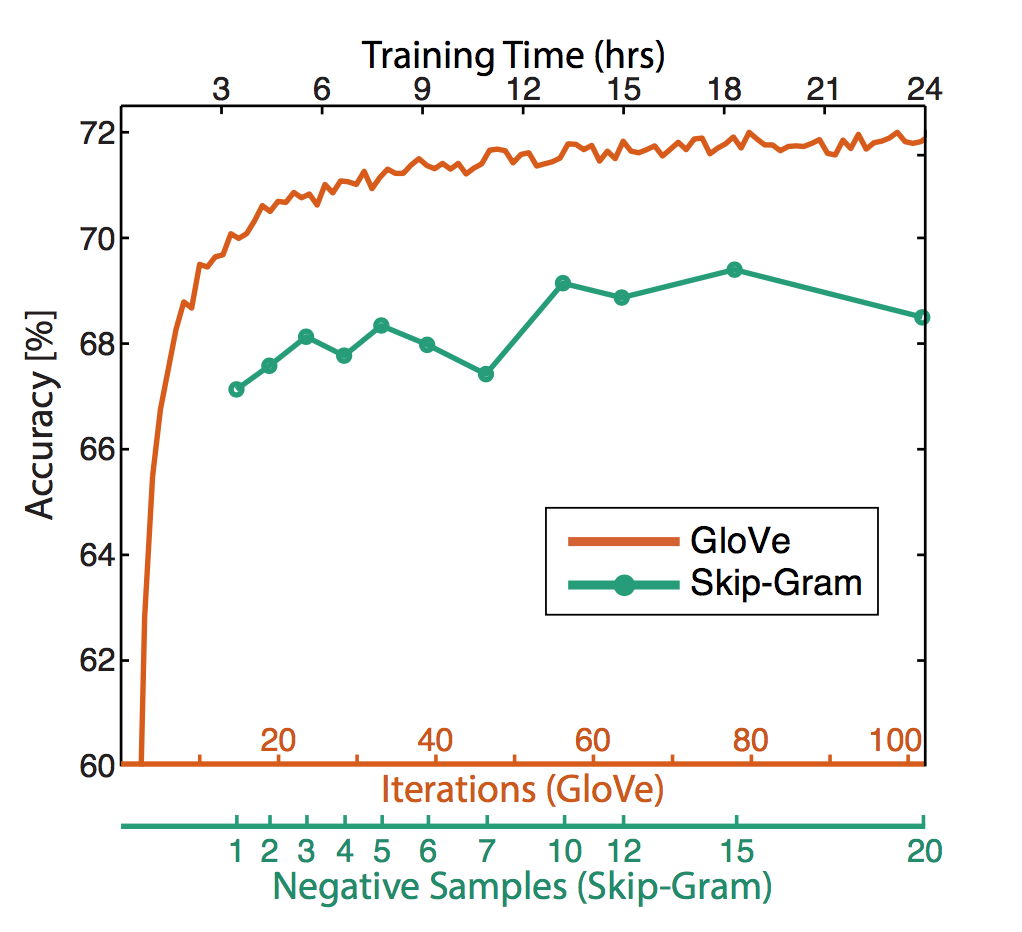

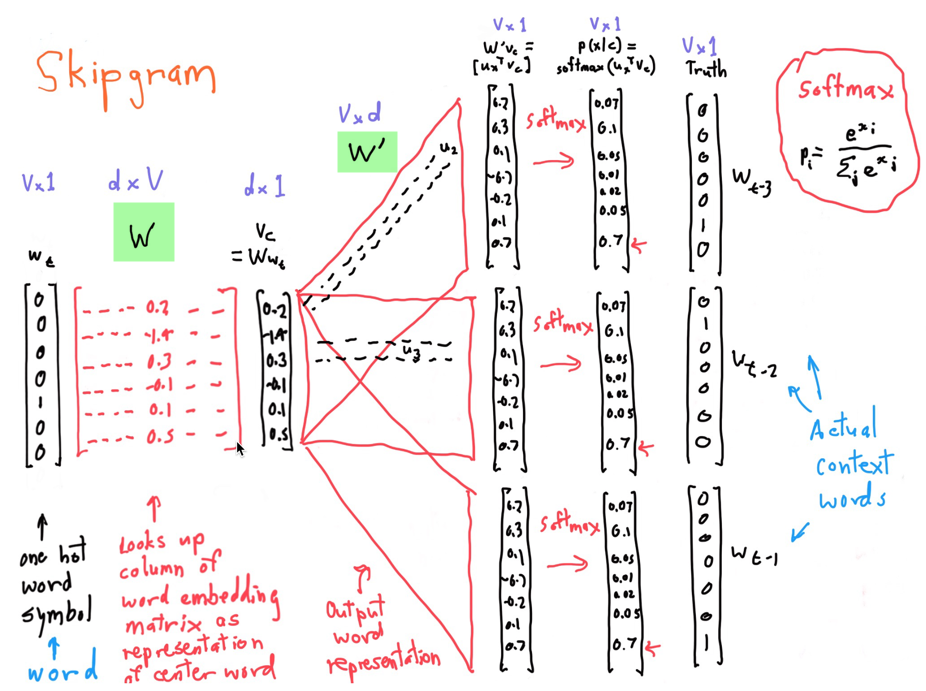

这节课从传统的基于计数的全局方法出发,过渡到结合两者优势的GloVe,并介绍了词向量的调参与评测方法。 复习:word2vec的主要思路 遍历整个语料库中的每个词 预测每个词的上下文: 然后在每个窗口中计算梯度做SGD SGD与词向量 但每...

词向量本身无法解决一词多义的问题,比如: 这里的tie可能表示球赛的平局,也可能表示领带,还可能表示绳子打结。那它的词向量究竟在哪里呢? 虽然相似的词被映射到邻近的位置,但该论文证明词向量是所有义项的平均: 它被映射到这些词语的中央,这有什...

如何表示一个词语的意思 先来看看如何定义“意思”的意思,英文中meaning代表人或文字想要表达的idea。这是个递归的定义,估计查询idea词典会用meaning去解释它。 中文中“意思”的意思更加有意思: 他说:“她这个人真有意思(fu...

这门课会不定期地让TA介绍一些课程相关的最前沿研究,与课程进度并非流畅衔接,所以单独做笔记。这次是第二节课中场休息时,由Danqi Chen带来的五分钟小讲座: 句子Embedding动机 虽然这节课一直在讲词向量可以编码词的意思,但自然语...

课上讲的太简略了,原理参考《word2vec原理推导与代码分析》。谷歌给的代码也很简陋,只有负采样,没有哈夫曼树。另外单机word2vec已经那么高效了,我质疑上TF的意义。 任务 5: Word2Vec&CBOW 这次的任务是在t...