Michael Collins NLP公开课任务2 PCFG

Micheal Collins在Coursera上的自然语言处理公开课,第二次任务。自然语言中的歧义令人忍俊不禁,只要你或者你的模型脑洞足够大。 语料库来自WSJ,但并不是乔姆斯基范式: 因为乔姆斯基范式中一元rule必须是叶子节点,修正方...

Micheal Collins在Coursera上的自然语言处理公开课,第二次任务。自然语言中的歧义令人忍俊不禁,只要你或者你的模型脑洞足够大。 语料库来自WSJ,但并不是乔姆斯基范式: 因为乔姆斯基范式中一元rule必须是叶子节点,修正方...

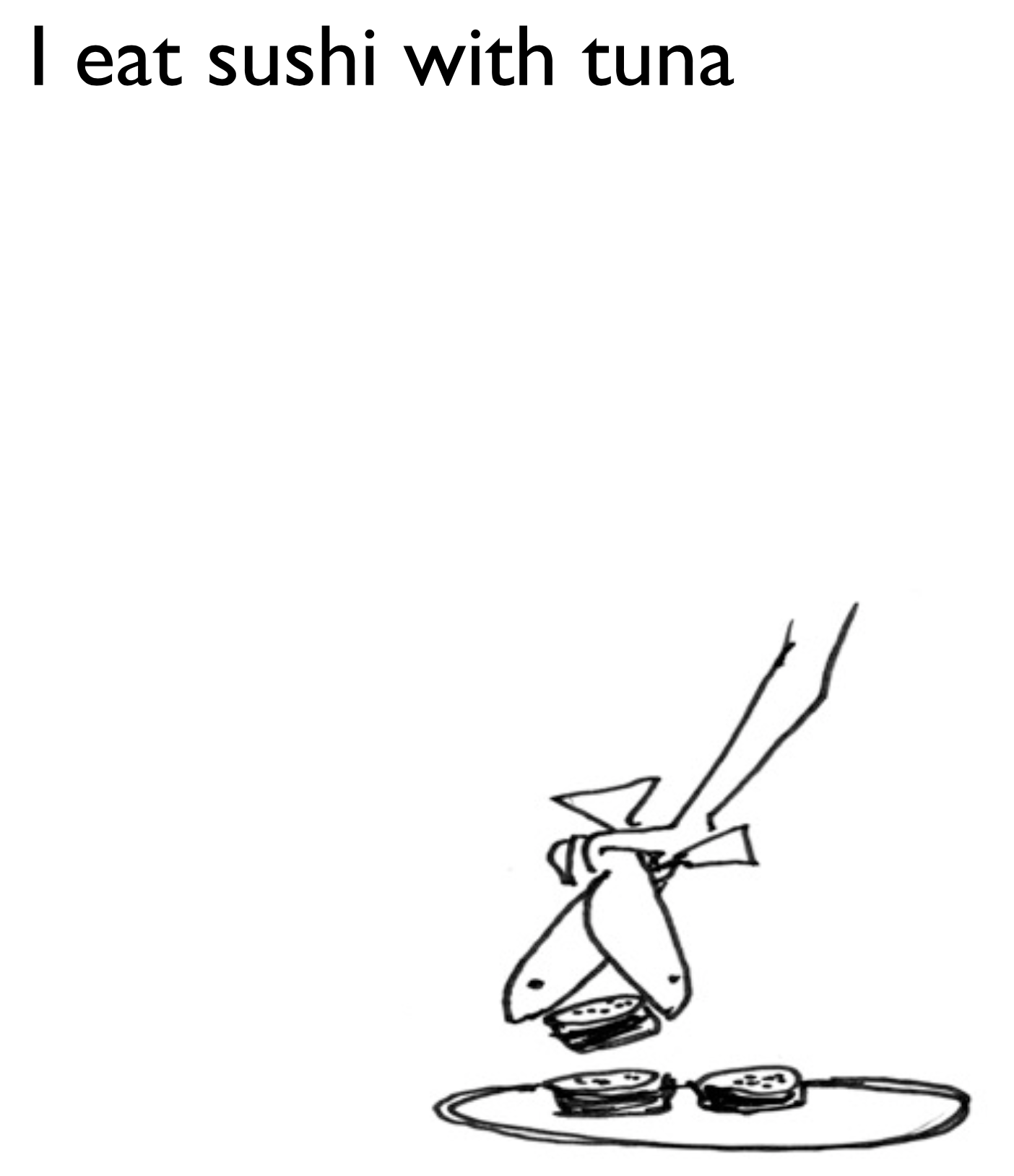

POJ 3678 Katu Puzzle 某组合电路有N个输入,M个与或异或门将其两两相连构成多个输出,问是否存在满足给定输出的输入。 4.3成为图论大师之路 2-SAT 每条边都是某个2输入门,最终输出为门的合取范...

最后一次任务,至此速战速决解决了这门快餐课程。心得是作为一个“懒惰的工程师”,对常见的深度学习模型、技巧、应用有了浅显的了解。但对“好奇的求知者”来讲,则只能说看了一张模糊不清的缩略图,许多理论和细节得通过正式一些的课程去补充。 任务 6:...

课上讲的太简略了,原理参考《word2vec原理推导与代码分析》。谷歌给的代码也很简陋,只有负采样,没有哈夫曼树。另外单机word2vec已经那么高效了,我质疑上TF的意义。 任务 5: Word2Vec&CBOW 这次的任务是在t...

课上浅显地介绍了卷积网络,以及配套的常用技巧。速成嘛,没深入探讨原理。编程任务直接给出了实现,要求也只是在其基础上做些小改进,过过干瘾。 任务 4: 卷积模型 设计并训练一个卷积神经网络。 前两次任务中,我们实现了较深的全连接多层神经网络,...

这次的看点是怎么在TensorFlow里实现正则化、dropout和学习率递减的技巧;顺便演示了下自动调参。 任务 3: 正则化 使用正则化去优化深度学习模型 题目1 给上次练习实现的逻辑斯谛回归和神经网络加上L2正则,检查性能提升。 逻辑...

三言两语讲完了反向传播,一个公式也没有,果然是面向“懒惰工程师”的快餐教程。比较喜欢“不提神经元,我们不是巫婆”的观点。这次不需要自己写算法,直接上TensorFlow了。 任务 2: 随机梯度下降 使用梯度下降和随机梯度下降训练一个全连接...

这是谷歌在优达学城上开的公开课,感觉就是TensorFlow的宣传片。肉眼观测难度较低,作为入门第一课快速过掉也许还行。课程概述中说: 我们将教授你如何训练和优化基本神经网络、卷积神经网络和长短期记忆网络。你将通过项目和任务接触完整的机器学...

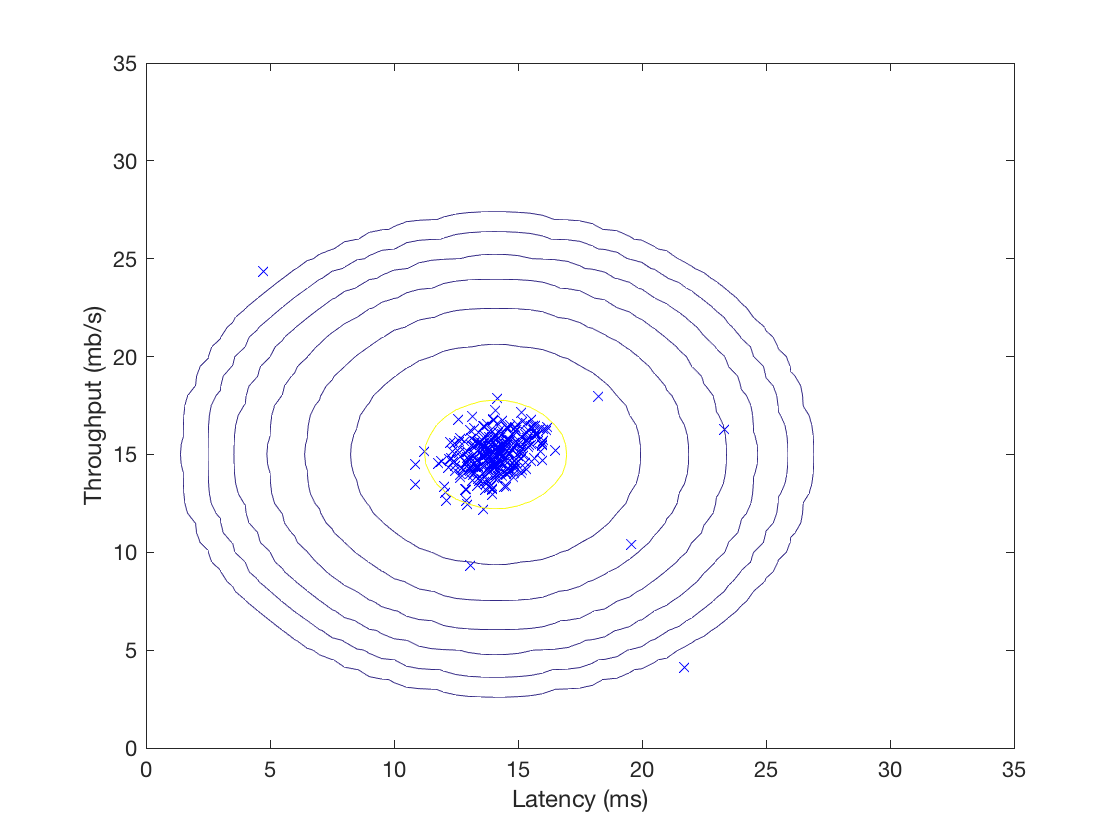

斯坦福ML(Matlab)公开课最后一次编程练习,实现了异常检测算法并应用于服务器异常检测,然后利用协同过滤实现一个电影推荐系统。至此又填完一个坑,matlab感觉也入门了。 异常检测 你收集了一些服务器的流量与延迟数据,假设大部分服务器都...

斯坦福ML(Matlab)公开课,这次练习先实现K-means聚类算法并应用于图像压缩,然后实现PCA并用于人脸图像,最后展示高维数据的可视化技巧。我发现matlab做动画特别方便,顺手把算法执行过程动画化了。 K-means聚类 循序渐进...