Hinton神经网络公开课编程练习2 Learning Word Representations

这次练习的任务是设计一个神经网络语言模型,给定前三个词语,预测第四个词语。通过训练该语言模型学习词的稠密表示,大部分代码已经写好,少量难点以选择题的方式给出。 数据集 词表大小250,训练集由30万个4-gram构成,开发集和测试集大小为5...

这次练习的任务是设计一个神经网络语言模型,给定前三个词语,预测第四个词语。通过训练该语言模型学习词的稠密表示,大部分代码已经写好,少量难点以选择题的方式给出。 数据集 词表大小250,训练集由30万个4-gram构成,开发集和测试集大小为5...

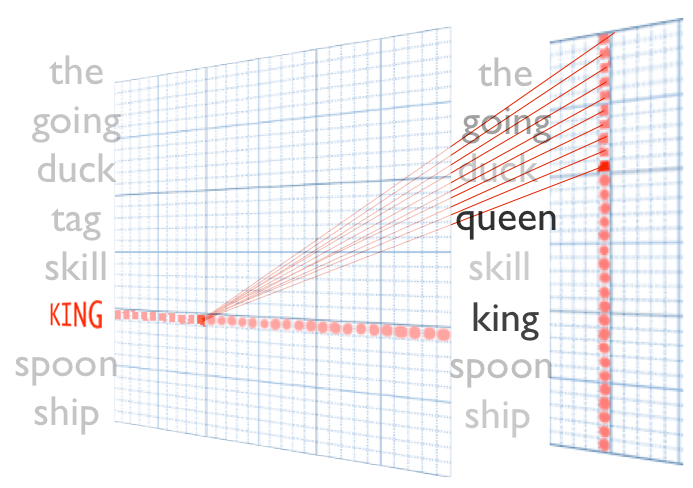

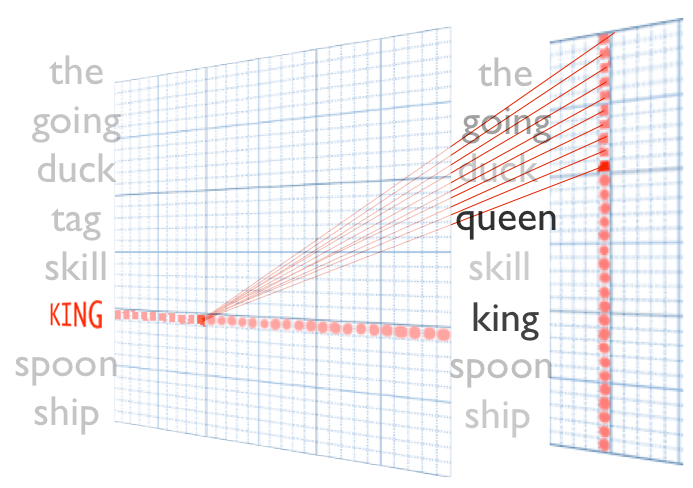

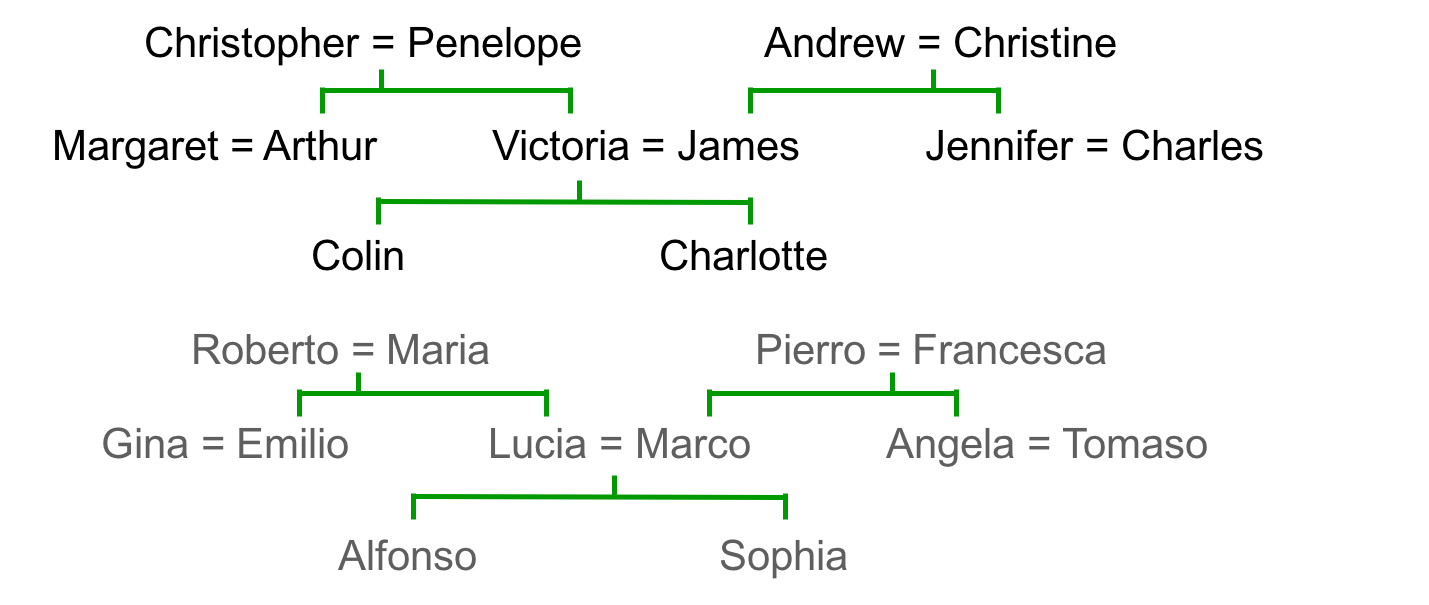

词的向量表示 关系信息的特征表示 引子很新奇,是一张英国人的家谱和一张结构相似的意大利人的家谱: 这是一种关系信息,比如甲的父亲是乙,=表示夫妻。神经网络可以通过反向传播学习这些关系对,将关系信息转为特征向量。最终的效果是,提问“乙的儿子是...

这门课的编程练习很简单,大部分代码都给出了,只需要修改或添加一小部分。官方语言为matlab,但我更喜欢Python(讨厌jupyter)。但matlab保存动画更方便,所以决定双语字幕,左右开弓。 算法主框架 这次的主题是感知机算法及可视...

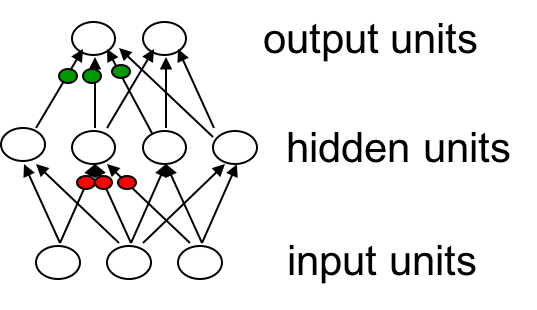

虽然反向传播很简单,但老爷子讲的更本质。另外线性回归→逻辑斯谛回归→反向传播神经网络是很多课程的必经之路。 为什么感知机算法不能用于训练隐藏层 其实前面一次课简单地提了下,说是线性隐藏层构成的模型依然是线性的。这节课展开了讲,感...

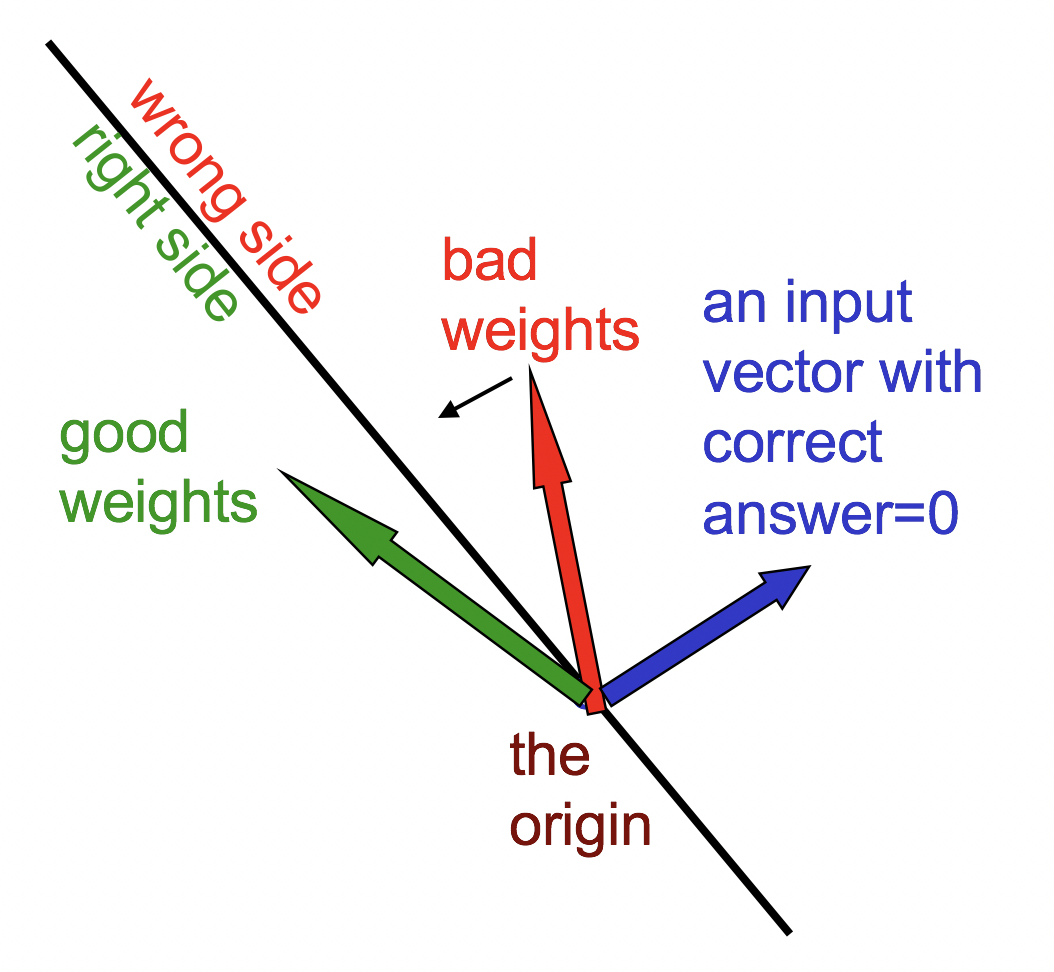

这是多伦多大学Professor Geoffrey Hinton的Neural Networks for Machine Learning公开课笔记,只记录难点,我已经掌握的知识点则不做记录。 Weight space 通常讲解感...

最后一次练习,对应课程结尾的对数线性模型框架;于是又拿下一门课。在这次练习中,我们将使用感知机算法训练一个GLM应用到命名实体识别上。对输入实例,GLM使用如下三个组件完成解码: 一个函数生成所有可能的结果 一个全局特征函数 一个参数向量 ...

断断续续花了三年时间,终于看完这本书,完成了所有习题。看书有很多种看法,开卷有益是一种,自始至终是另一种。有些题目很难,至今AC数只有数十人。据此估计,完整读完这本书的人应该不超过十这个量级。 读书的动机也有很多种,我既不是运动员,也不为面...

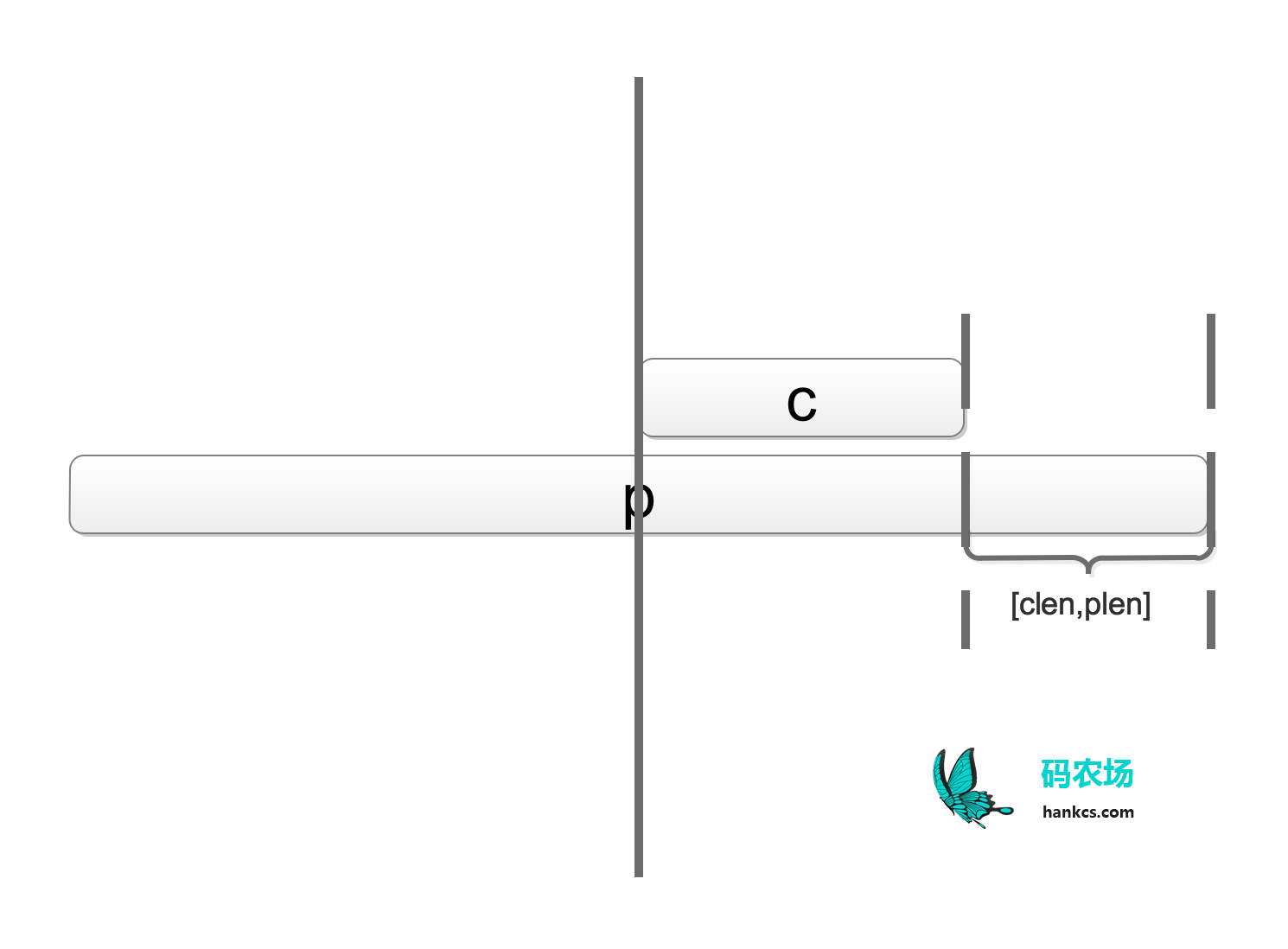

Codeforces 123D String 子串函数和:求字符串的所有子串出现次数n代入n(n+1)/2之和。 4.7华丽地处理字符串 后缀数组 题目有些绕,直白地讲就是枚举所有不同的子串,求出现次数,...

AOJ 2292 Common Palindromes 公共回文子串:求两个串的公共回文子串个数。 4.7华丽地处理字符串 后缀数组 拼接后先预处理出后缀数组、高度数组和回文半径数组。其中,每个位置的回文...

POJ 3729 Facer’s string 公共子串: 给出两个字符串A,B,求满足下列条件的C的个数: C是A的子串 C也是B的子串 C加上其在A中的后继字符(若在最尾则加上空格字符)不能够在B中出现 4.7华丽地处理字符...